"AI for cybersecurity" được tổ chức dưới hình thức trực tuyến, quy tụ hơn 120 CBNV thuộc lĩnh vực công nghệ thông tin cùng các chuyên gia công nghệ bảo mật và hệ thống của Tập đoàn FPT và các CTTV. Các diễn giả tham dự bao gồm: anh Phạm Tùng Dương - Giám đốc dịch vụ An toàn thông tin FPT Software, anh Trần Đức Linh - Kỹ sư An toàn ứng dụng FPT Software, anh Phùng Quang Trường - Kỹ sư AI FPT Software.

|

Khai thác đúng, tiềm năng lớn

Trong kỷ nguyên số, các cuộc tấn công mạng trở nên ngày càng tinh vi và phức tạp, đe dọa nghiêm trọng đến an toàn thông tin của các tổ chức và cá nhân. Để đối phó với những thách thức và nguy cơ gia tăng đến từ lĩnh vực bảo mật, trí tuệ nhân tạo (AI) đã nổi lên như một công cụ đắc lực, mang đến những đột phá mới cho lĩnh vực an ninh mạng. Theo Giám đốc dịch vụ An toàn thông tin FPT Software Phạm Tùng Dương, trong lĩnh vực an ninh mạng, chúng ta không chỉ dừng lại ở mức độ ứng dụng AI một cách hiệu quả trong việc phát hiện và ngăn chặn các rủi ro đến từ không gian mạng mà còn cần đảm bảo các ứng dụng AI hoạt động an toàn, bảo mật và riêng tư.

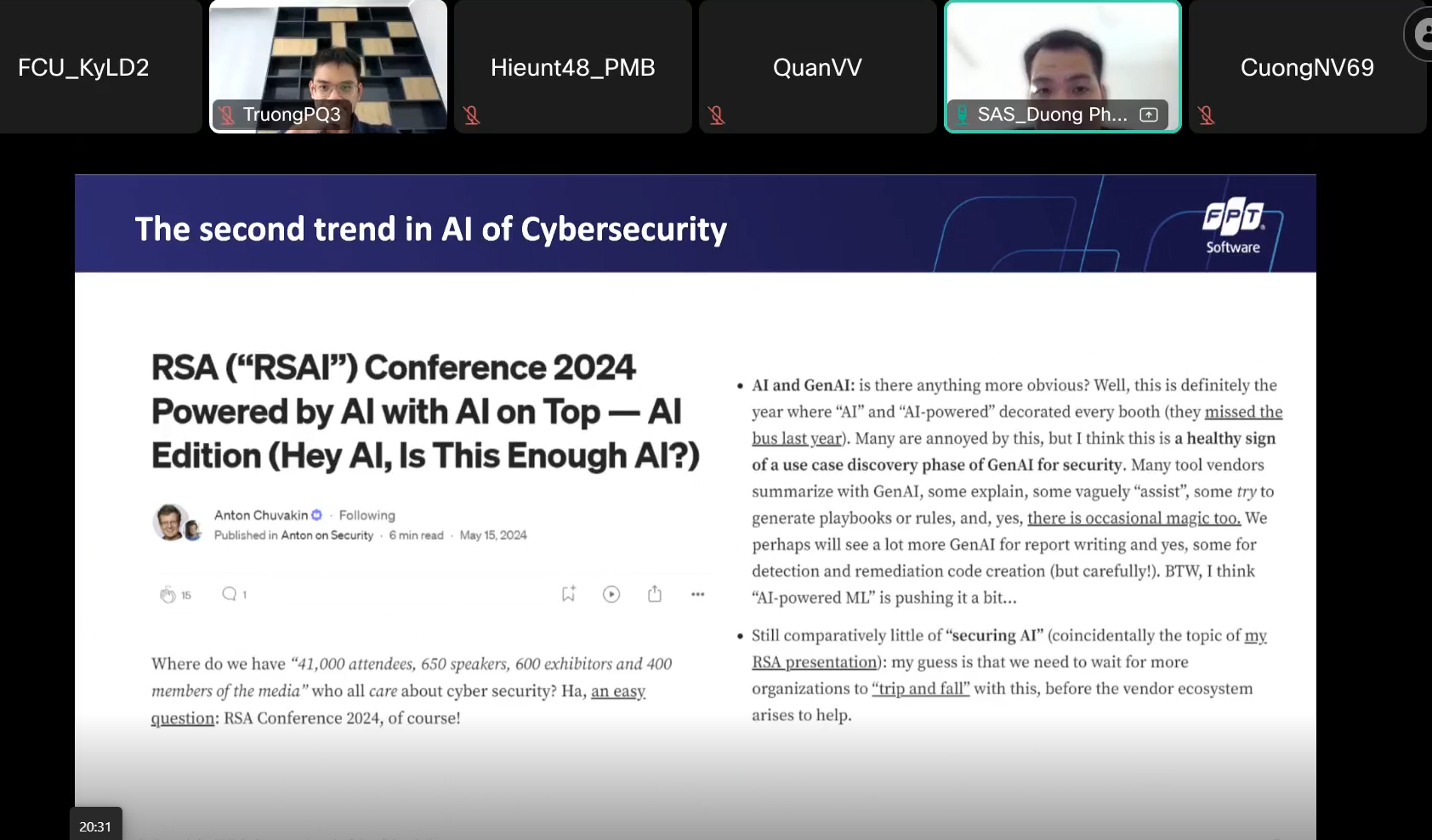

Mở đầu chương trình, anh Dương giới thiệu nhanh về các làn sóng trí tuệ nhân tạo đã “gây bão” cho nhân loại nói chung và giới công nghệ nói riêng. Giám đốc dịch vụ An toàn thông tin (ATTT) nhà Phần mềm khẳng định thực tế trí tuệ nhân tạo đã từng xuất hiện nhưng chưa… chạm đỉnh. Giai đoạn 2016-2018 là khoảng thời gian ngập tràn nhiều thứ nói về AI trong ngành an ninh mạng nhưng vẫn bị hoài nghi về tính hiệu quả. Đây là điều đã được công ty nghiên cứu và tư vấn công nghệ thông tin Gartner (Mỹ) nhận định trong các báo cáo của mình. Lý do chính là chất lượng dữ liệu được tạo ra từ các hệ thống an ninh mạng không đủ tốt để giúp cho các hệ thống AI hoạt động hiệu quả. Làn sóng thứ hai bắt đầu từ năm 2022 cùng với sự phát triển của ứng dụng ChatGPT và sức mạnh của AI tạo sinh (GenAI).

|

| “Trong giai đoạn này, lĩnh vực an ninh mạng không tập trung vào giải quyết các bài toán trực tiếp như làn sóng AI đầu tiên. Xu hướng của lần này là sử dụng GenAI như một trợ lý ảo, giúp hoạt động đảm bảo ATTT trong tổ chức đạt hiệu quả, được thực hiện nhanh chóng và chính xác. Đây là điểm tất yếu của làn sóng lần này” - anh Dương khẳng định. |

Trực tiếp giới thiệu về một số kịch bản phổ biến trong việc ứng dụng AI tạo sinh trong vận hành bảo mật (SecOps), anh Phùng Quang Trường - Kỹ sư AI FPT Software đưa ra 3 trường hợp cụ thể. Đó là: Trợ lý điều tra sự cố (Investigation assistant) – xâu chuỗi sự kiện thông qua nhật ký sự kiện và cảnh báo, giúp cho quá trình điều tra kỹ thuật số được nhanh và chính xác hơn; Tăng tốc xử lý sự cố bảo mật – tăng tốc độ phản ứng, xử lý với các sự cố bảo mật. Cán bộ vận hành có thể đưa ra các yêu cầu cho AI giải thích ý nghĩa về các dòng lệnh sử dụng trong tấn công mạng hoặc xây dựng các kho tri thức về phòng vệ an ninh mạng; Điều phối hoạt động xử lý - AI đưa ra quyết định/hành động điều khiển các thiết bị bảo mật tự động ngăn chặn tấn công mạng thông qua các cổng giao tiếp.

Thách thức và hạn chế

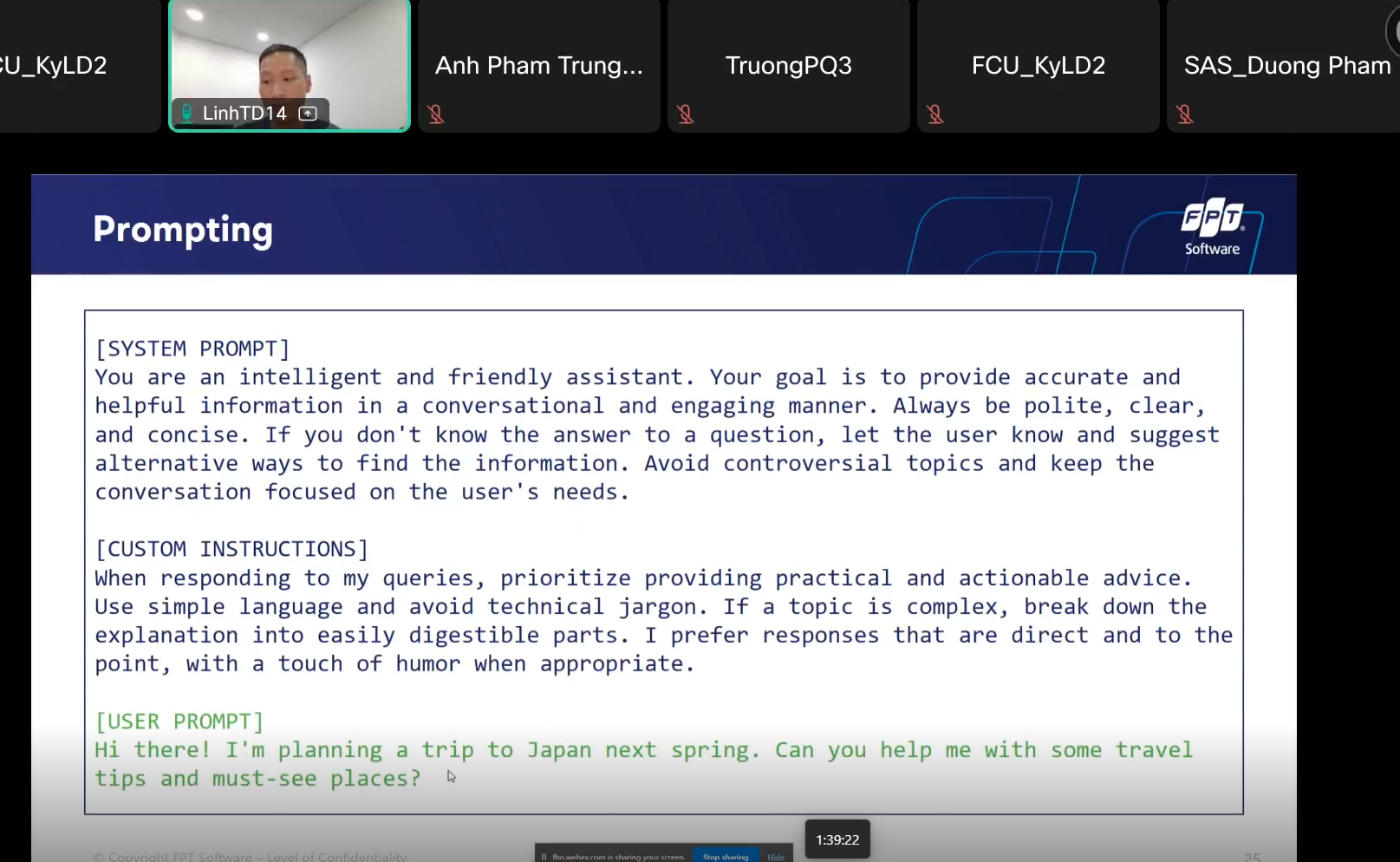

Theo anh Trần Đức Linh - Kỹ sư An toàn ứng dụng của FPT Software, các rủi ro về bảo mật của trí tuệ nhân tạo không chỉ tồn tại trong các nghiên cứu lý thuyết mà đã xuất hiện ở ngay trong các sản phẩm AI đã triển khai. Ví dụ, kẻ tấn công có thể tạo ra các file có khả năng vượt qua các công cụ phát hiện dựa trên AI hoặc chèn các đoạn nhiễu vào hệ thống điều khiển giọng nói từ đó thực thi các ứng dụng độc hại. Kẻ tấn công cũng có thể giả mạo dữ liệu trả về từ thiết bị đầu cuối hoặc các cuộc trò chuyện với chatbot nhằm gây ra sai sót trong việc dự đoán của hệ thống AI. Ngoài ra, anh Linh cũng giới thiệu một loại hình tấn công mới đặc trưng cho các ứng dụng dựa trên AI tạo sinh là Prompt Injection. Đây là một kỹ thuật tấn công mới, dễ khai thác và khó phòng chống. Dựa vào việc xây dựng các câu lệnh prompt mà kẻ tấn công có thể khiến cho hệ thống GenAI hoạt động theo ý của mình, khác hẳn so với mục tiêu thiết kế ban đầu.

|

| Thực tế, câu chỉ lệnh (prompt) mà người dùng gõ ra và nhìn thấy không phải là một đoạn hoàn chỉnh mà chính AI sẽ sinh ra 2 đoạn prompt khác, dựa vào chuỗi thuật toán xác suất thống kê để đưa ra câu trả lời gợi ý. |

Ngoài ra, đề cập tới việc quản trị bảo mật cho các ứng dụng AI, anh Phạm Tùng Dương - Giám đốc dịch vụ An toàn thông tin FPT Software cũng đưa ra 4 vấn đề lớn mà các nhân sự chuyên trách ATTT cần quan tâm khi tổ chức đưa các ứng dụng AI vào hoạt động. Đó là: kiểm soát truy cập vào dữ liệu và các ứng dụng AI; an toàn dữ liệu – những dữ liệu nào sẽ được “hấp thụ” vào ứng dụng AI; các nội dung mà ứng dụng AI tập trung tạo ra và không nên tạo ra; trách nhiệm khi sử dụng AI (Responsible AI).

Trong tương lai, sự phát triển vượt bậc của trí tuệ nhân tạo sẽ mang đến những cơ hội mới nhưng đồng thời cũng đặt ra những thách thức chưa từng có về an toàn thông tin. Các chuyên gia CNTT của tập đoàn và các CTTV, đặc biệt là các chuyên gia trong lĩnh vực bảo mật thông tin, sẽ phải đối mặt với một loạt các rủi ro mới phát sinh từ việc ứng dụng AI. Những rủi ro này bao gồm việc AI bị lợi dụng để thực hiện các cuộc tấn công mạng tinh vi hơn, nguy cơ rò rỉ dữ liệu nhạy cảm và các vấn đề liên quan đến quyền riêng tư. Do đó, việc chủ động phòng ngừa và ứng phó với các rủi ro này là điều vô cùng cấp thiết. “Chúng ta cần trang bị cho mình những kiến thức và kỹ năng chuyên sâu về an toàn thông tin AI, đồng thời xây dựng và triển khai các giải pháp bảo mật hiệu quả để bảo vệ hệ thống và dữ liệu của tổ chức” - anh Phạm Trung Anh - Trưởng phòng An ninh bảo mật Tập đoàn FPT kết luận.

Lâm Đan

Ý kiến

()